2023-12-19 16:05

2023-12-19 16:05

Stable Diffusion落地应用案例丨关于如何进行品牌视觉延展设计

设计师在从事品牌视觉相关设计的过程中,往往离不开使用品牌视觉符号进行主题化或风格化设计,下面就为大家分享如何使用stable diffusion来辅助进行品牌视觉logo延展设计。

在进行设计之前我们需要先下载Controlnet QR Code Monster模型,该模型可以很好的帮助我们对品牌视觉符号logo图形进行比较准确的控制。

模型下载传送门:

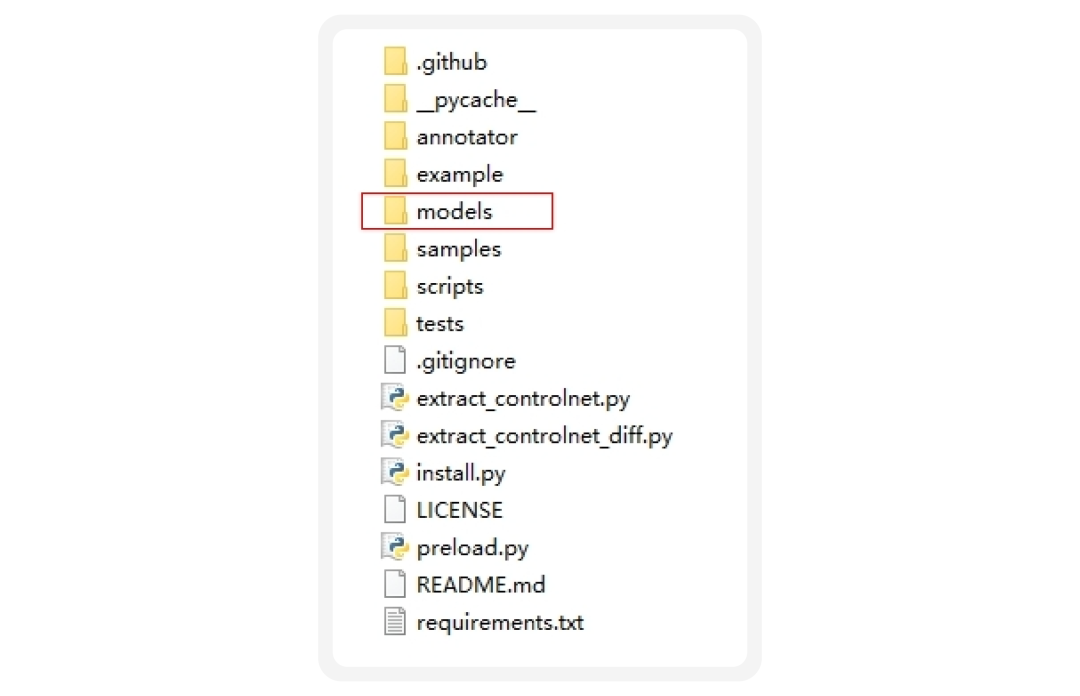

进入传送门下载 control_v1p_sd15_qrcode_monster.safetensors、control_v1p_sd15_qrcode_monster.yaml 两个文件。

并将文件存放在 extensions\sd-webui-controlnet\models 文件中。

完成基本环境搭建后,我们进入做前期素材准备环节。准备好想要进行视觉延展的原始品牌符号素材以及预期构思的视觉风格prompt关键词。

我们以苹果logo为例,准备的原始素材图片使用了512x512像素尺寸,素材尺寸可以根据个人实际需要调整。为了方便controlnet识别控制结构,素材的颜色这里我们需要统一处理成黑白稿。

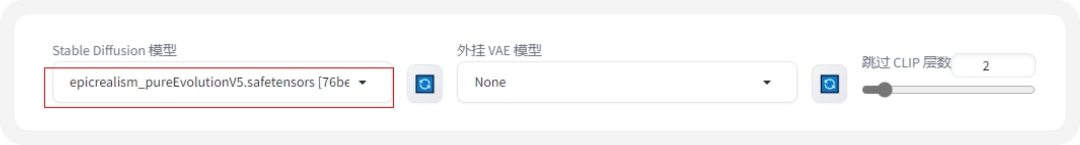

准备好素材后,进入Stable diffusion 文生图界面。

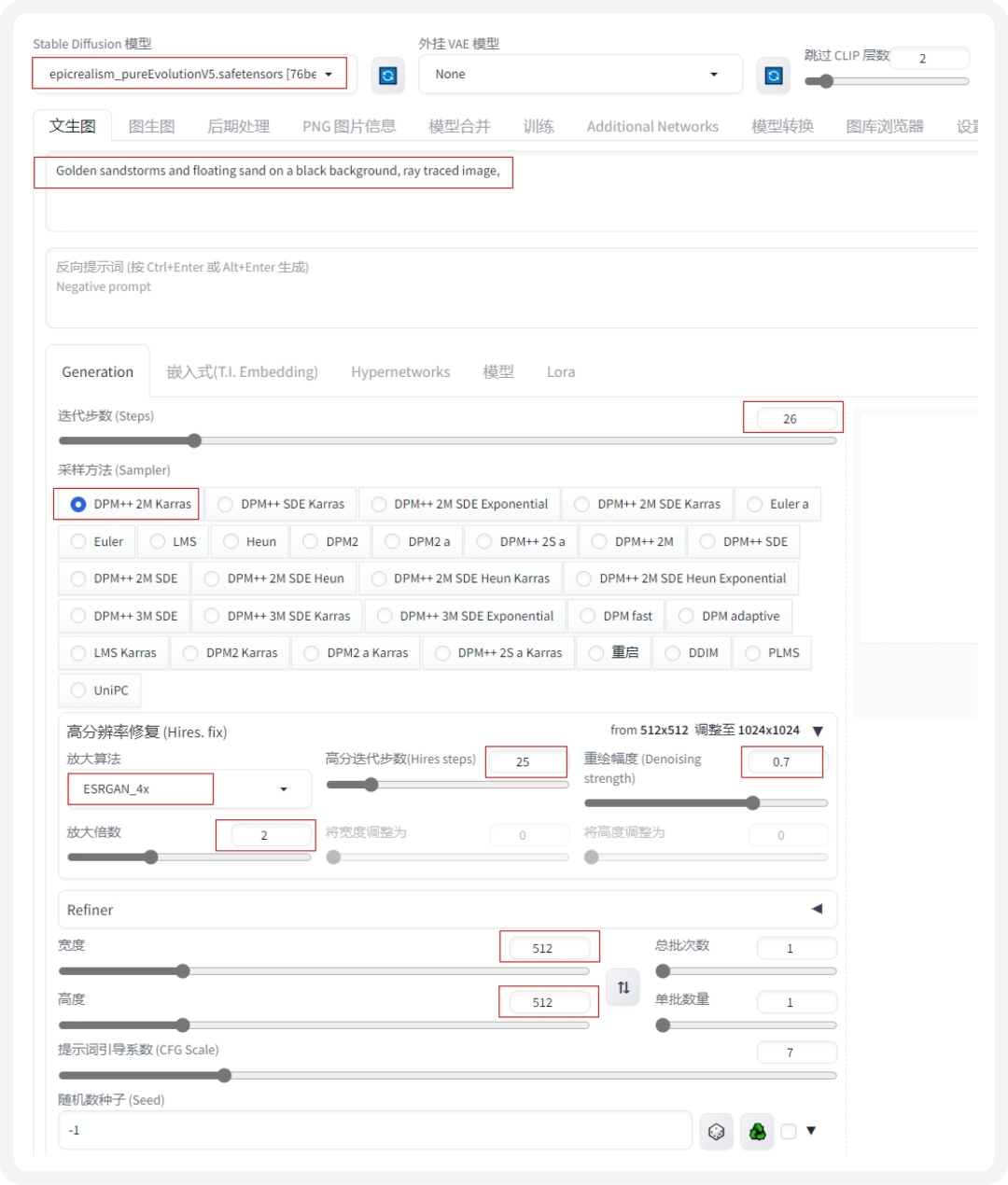

Stable diffusion模型这里以epicrealism_pureEvulutionV5为例,如果没有该模型也可以选择任意其他偏写实类的模型。

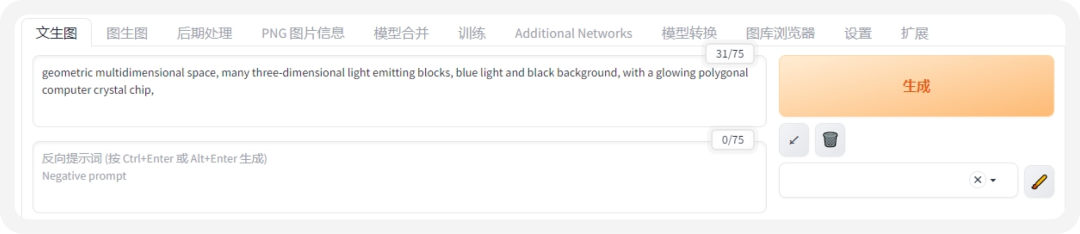

我们以硬件主题为例对苹果品牌进行视觉扩展,围绕硬件主题发散出计算机、晶片、芯片、空间、多维等Prompt关键词。在文生图文本框中输入Prompt:

geometric multidimensional space, many three-dimensional light emitting blocks, blue light and black background, with a glowing polygonal computer crystal chip,

如果发散不出比较合适的关键词,也可以先在网上收集一些比较贴切的设计参考,在图生图界面下置入参考图片,点击CLIP反推提示词,选取里面生成的词汇再输入文生图的Prompt中。

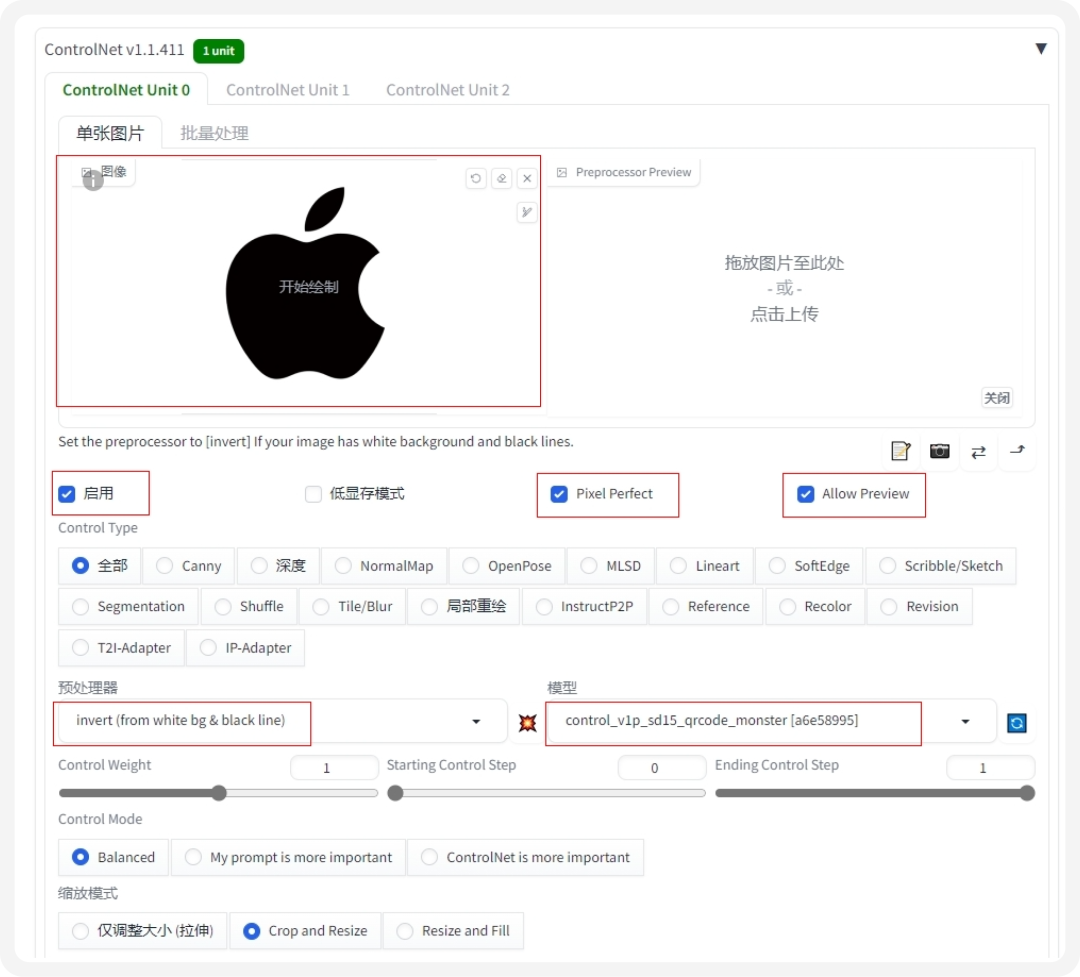

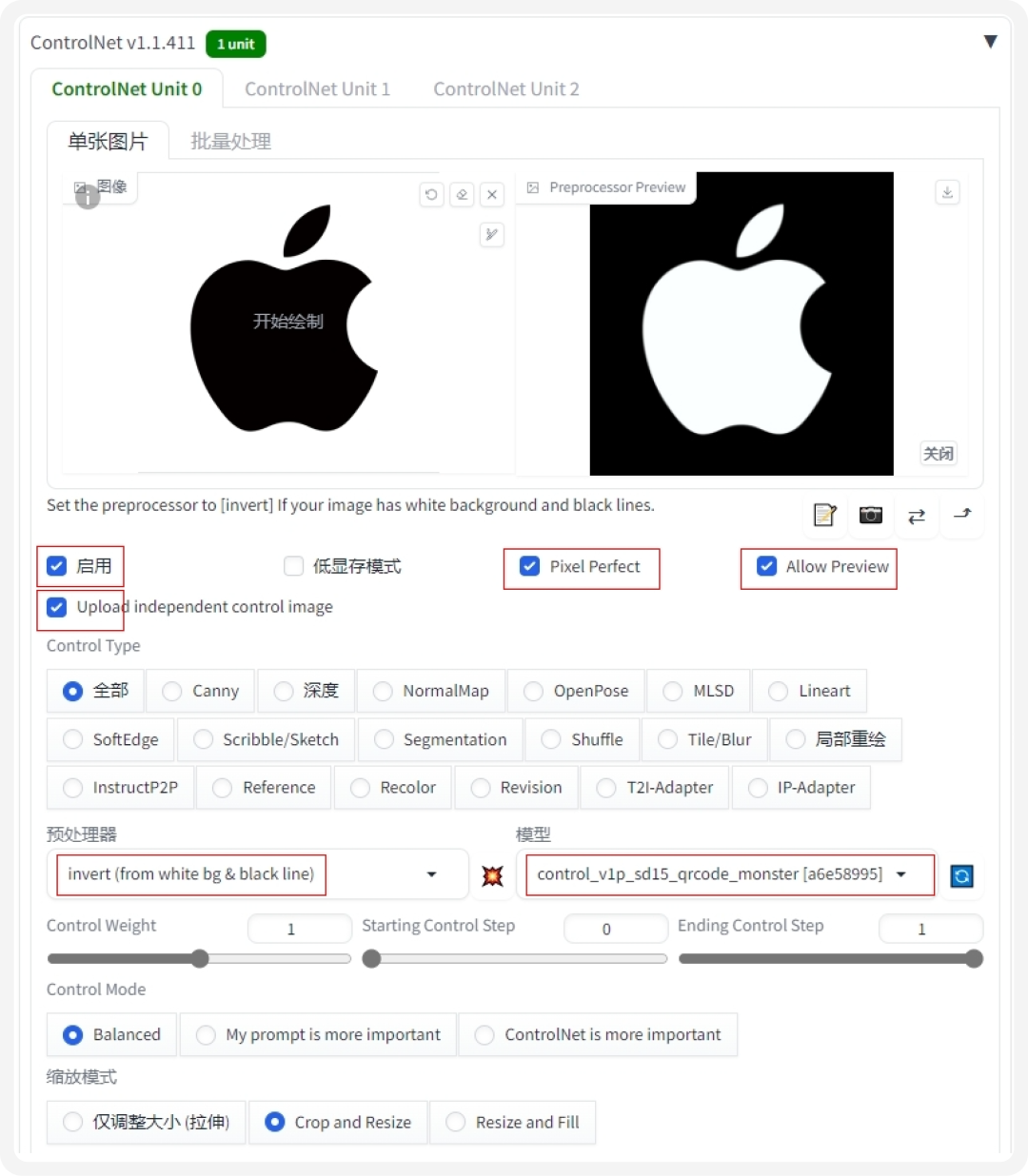

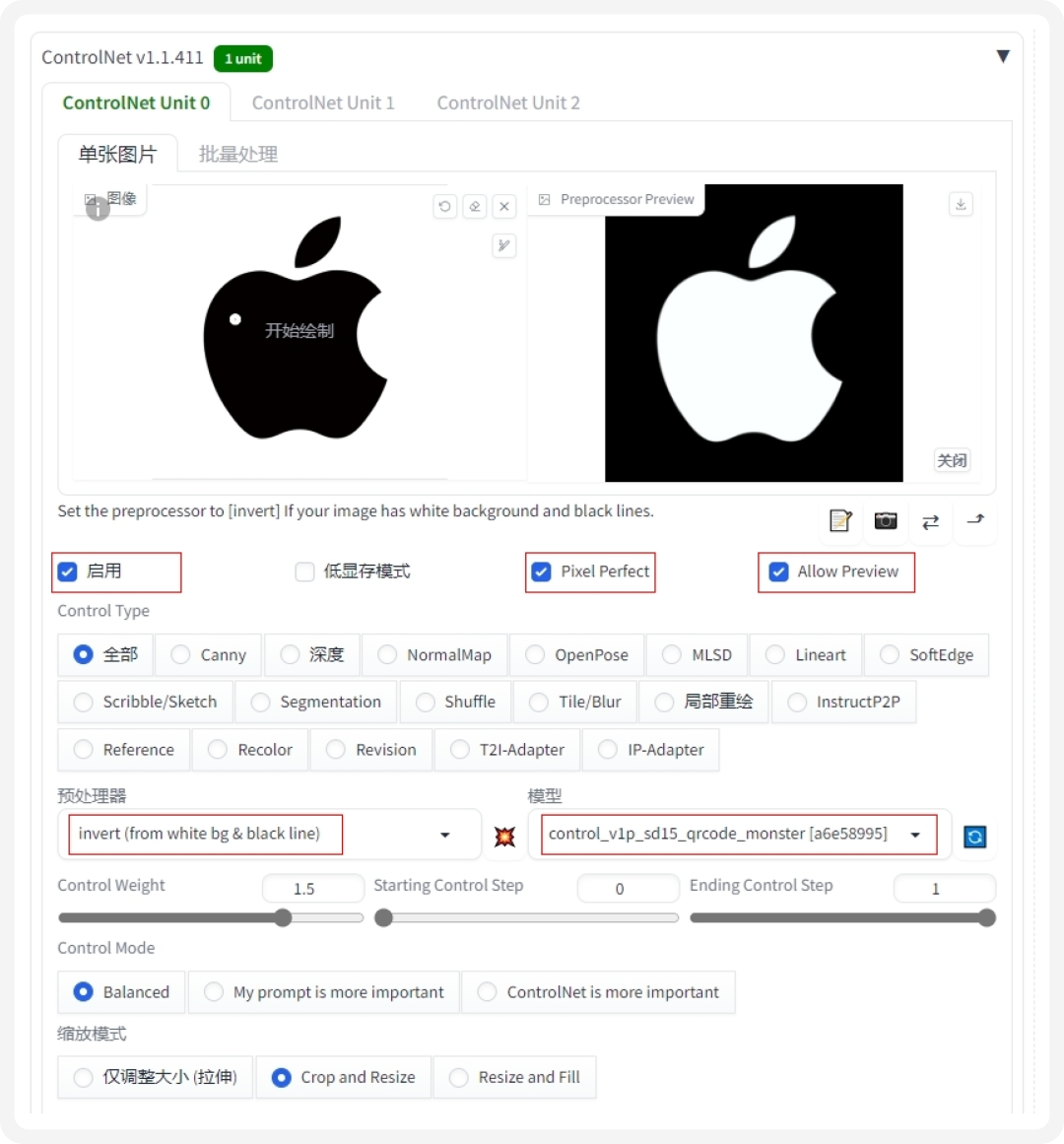

完成prompt输入后,我们进行生成调试环节。点击controlnet插件,将黑白图片素材拖放至controlnet,勾选“启动”,“pixel perfect”和“Allow Preview”选项。

新版ControlNet 1.1新增Pixel Perfect(完美像素模式)可以让ControlNet 自动计算最佳预处理器分辨率,实现与 Stable Diffusion 的完美匹配。

如果没有该选项,可以通过进入扩展选项,点击从网址安装, 复制粘贴以下链接到扩展的git仓库网址,安装完后重启界面即可使用。

GitHub - Mikubill/sd-webui-controlnet: WebUI extension for ControlNet

预处理选择invert,模型选择control_v1p_sd15_qrcode_monster,其他选项保持默认即可。点击中间红色爆炸图标,可以预览反白效果。如果希望最终生成的视觉效果logo图形部分以深色为主,则预处理器则可以选择无。

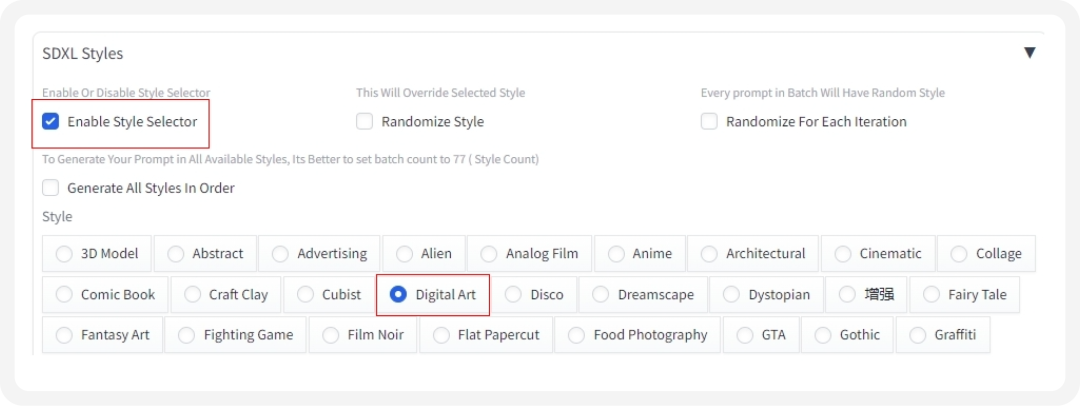

在SDXL Styles 界面中勾选“Enable Style Selector” ,Style中勾选“Digital Art”。

该选择器可以提供的选项生成不同类型的风格。如果没有该选项,同样可以复制以下链接在扩展中进行在线安装。

https://github.com/ahgsql/StyleSelectorXL

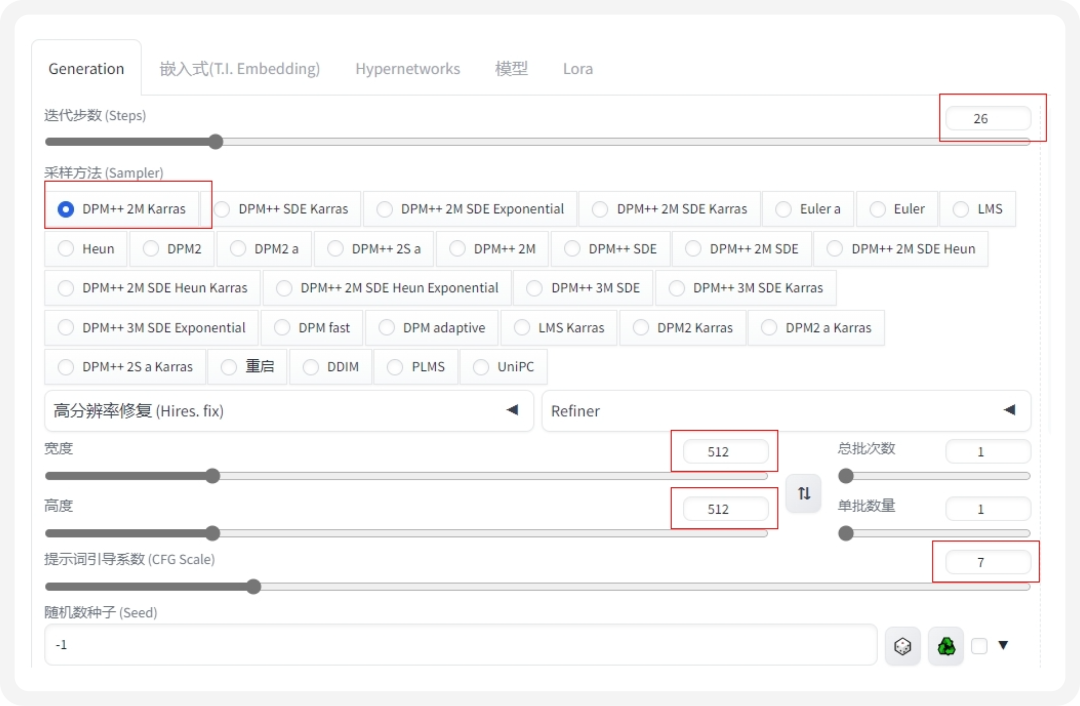

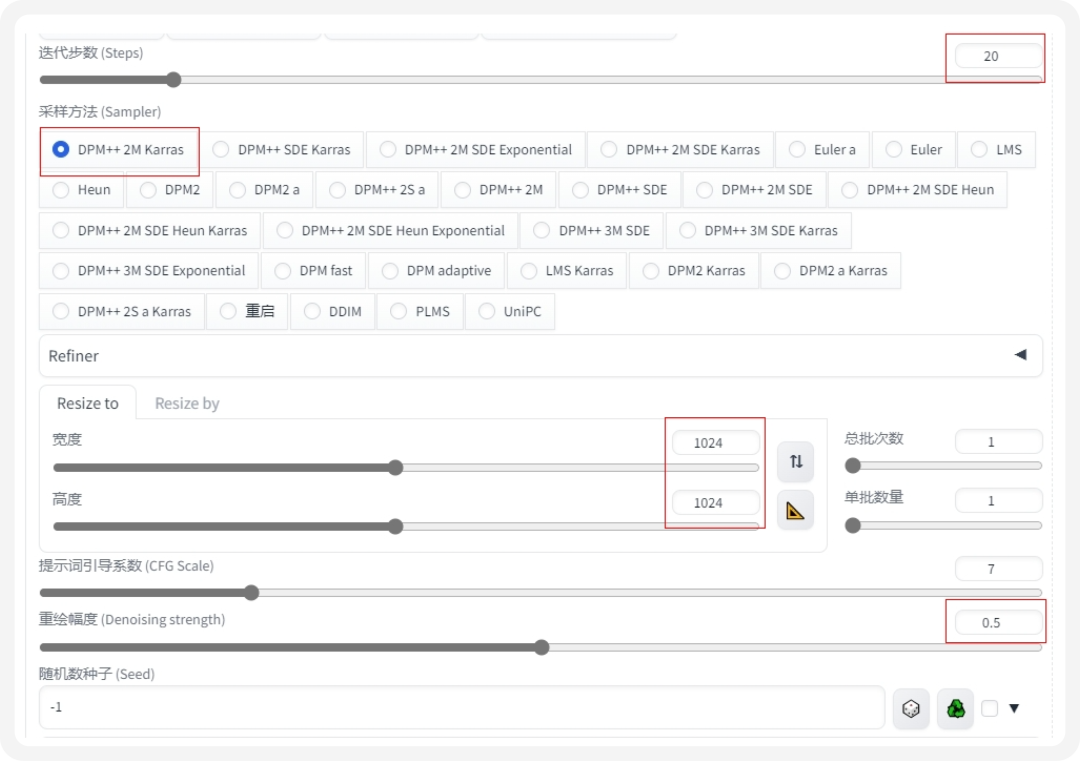

选择迭代步数,采样方法,宽度和高度,提示次引导系数。宽度和高度这里设置为512.为了方便快速生成不同效果图。

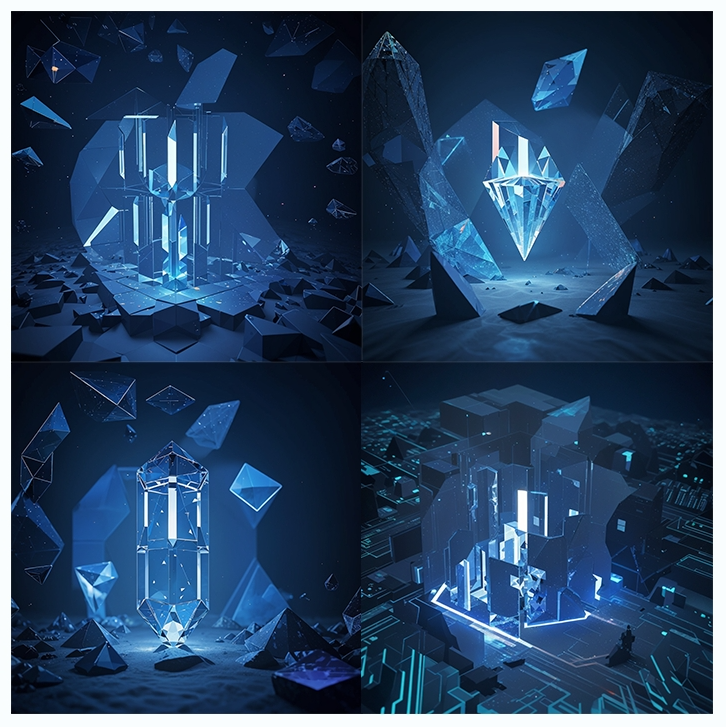

设置好参数后,点击生成开始抽卡。

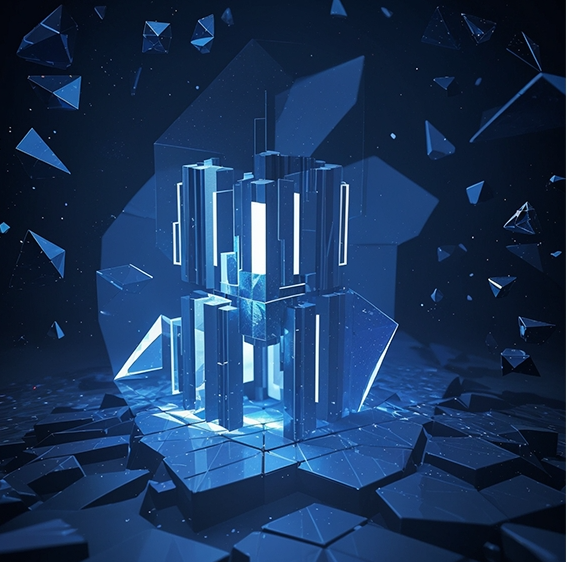

在生成的图片中选择比较符合设想期望的方向。这里以左上角第一张图为例。

我们在随机数种子中输入符合方向的图片种子,并通过高分辨率修复放大图片精度。在高分辨率修复 (Hires. fix)界面中选择放大算法ESRGAN_4x,设置高分迭代步数,重绘幅度,放大倍数。迭代步数一般选在 10~20 ,步数超过 20 可能会出现畸形。重绘幅度一般在 0.3~0.8 ,根据实际效果调整,如果希望变化更大就调高数值。

点击生成重绘后的图片。

通过PS对生成的画面进行简单处理,将画面中心融入更多发光晶体元素。

我们切换到图生图模式,将处理后的图片放到图生图模式进行二次生成。输入与文生图模式一样的Prompt。设置迭代步数,采样方法,宽度和高度和重绘幅度。

controlnet参数与前面文生图基本一致。

设置好参数后,就可以点击生成了。在这个过程中,可以根据效果调整重绘幅度,直到生成比较满意的画面。

最终效果。

使用同样的方法,可以尝试不同设计主题风格。我们以环境为主题,我们输入沙漠相关的Prompt,比如Golden sandstorms and floating sand on a black background, ray traced image,

设置基本参数。

Style可以选择cinematic。

设置Controlnet参数,可以提高Control Weight强度,让图形轮廓更加明显。

完成参数设置后,开始抽卡生成图片。

我们选择右图进行进下一步生成,在PS中进行简单处理调整底部和头部结构,将火焰替换为沙尘效果。

PS完后我们切换到图生图模式,置入处理后的图片,输入与前面一样的prompt和参数设置。

然后就可以点击生成符合期望的最终画面效果啦。

有了主视觉效果之后,相关延展应用就水到渠成,结合信息内容以及根据应用环境对视觉效果进行适配扩充。

以上就是我们在使用StableDiffuse辅助品牌视觉延展的制作过程。整体的制作思路可以大概拆解为6个步骤:以品牌视觉符号为核心>>提炼主题风格关键词>>使用Contrnet控制品牌识别度>>选择符合方向的画面>>结合图生图模式合成细化画面>>完成最终品牌主视觉。

AI的出现为我们节省了大量后期制作的时间,让我们可以更快地达成目标,也让我们有更多的空间去探索表现的形式与内容。AI工具可以决定输出的下限,而设计师的想象力决定了可以触达的上限。合理的借助AI尽情地发挥你的想象力去尝试各种可能吧!

其他品牌视觉效果

近期文章

更多